VGE PromptGuard v1g: open-weight model detekcji prompt injection

Czym jest VGE PromptGuard v1g

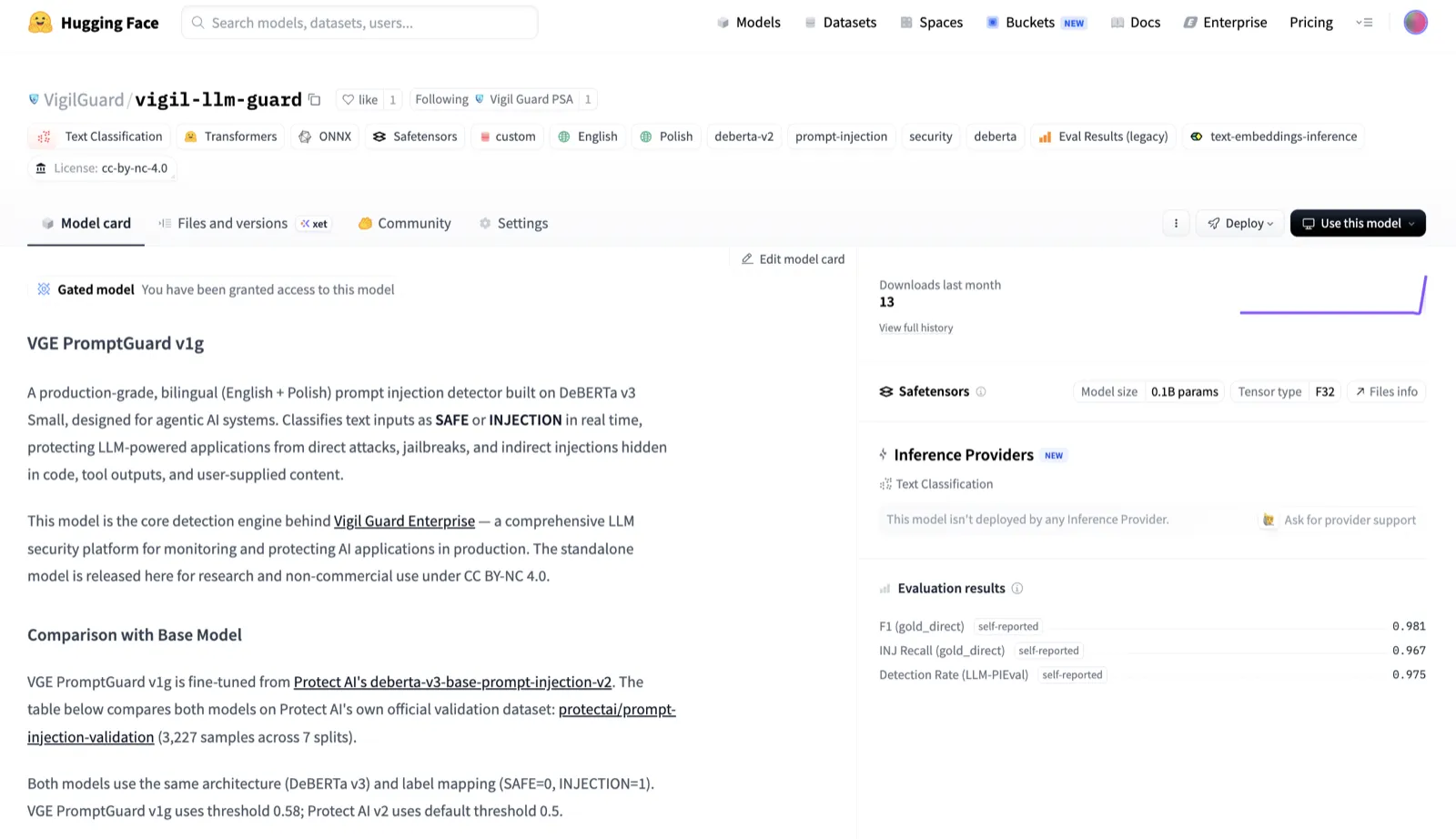

VGE PromptGuard v1g to silnik detekcji działający wewnątrz Vigil Guard Enterprise. Klasyfikuje dane wejściowe jako SAFE lub INJECTION w czasie rzeczywistym, chroniąc aplikacje LLM przed bezpośrednimi atakami, jailbreak'ami i pośrednimi iniekcjami ukrytymi w kodzie, wynikach narzędzi i treściach dostarczanych przez użytkowników.

Model oparty jest na architekturze DeBERTa v3 Small: 44 miliony parametrów, 6 warstw, 768 wymiarów ukrytych. Wystarczająco mały, by uruchomić inferencję na CPU w czasie rzeczywistym. Wystarczająco precyzyjny, by przewyższać modele o rząd wielkości większe na benchmarkach prompt injection.

Udostępniamy go na Hugging Face na licencji CC BY-NC 4.0 do celów badawczych i niekomercyjnych. Wersja produkcyjna jest dostarczana jako część Vigil Guard Enterprise z pełnym pipeline'em preprocessingu, optymalizacją ONNX i zarządzanym wdrożeniem.

Zbudowany dla agentycznych systemów AI

Większość detektorów prompt injection analizuje wiadomości użytkownika w izolacji. To działa, gdy użytkownik pisze bezpośrednio do chatbota. Przestaje działać, gdy agenci AI zaczynają wywoływać zewnętrzne narzędzia, przetwarzać odpowiedzi API i realizować wieloetapowe workflow.

VGE PromptGuard v1g był trenowany na kodzie źródłowym od fazy Masked Language Model. Rozumie strukturę kodu, formaty wyników narzędzi i wzorce zwracanych wartości funkcji. Model zawiera 3-warstwowy pipeline preprocessingu, który wyodrębnia payloady po znacznikach APIResults, ToolOutput i FunctionReturn, wyłapując iniekcje ukryte głęboko w agentycznych workflow.

Na benchmarku LLM-PIEval (750 próbek scenariuszy agentycznych ataków injection) VGE PromptGuard v1g osiąga 97.5% wykrywalności z pipeline'em ekstrakcji payloadów.

Wydajność vs rozmiar

Testowane na zbiorze walidacyjnym Protect AI (3 227 próbek w 7 splitach). Ten sam zbiór testowy, to samo mapowanie etykiet, niezależnie odtwarzalne. VGE PromptGuard v1g dostarcza 2x wyższe F1 ogólne, utrzymując wskaźnik fałszywych alarmów poniżej 1% na produkcyjnym ruchu.

Różnica w FPR ma znaczenie w praktyce. Model, który oznacza 42.5% prawidłowych promptów jako ataki, jest nieużywalny w produkcji. Każdy fałszywy alarm podważa zaufanie i generuje szum operacyjny. Przy 0.0% FPR na benchmarku gold i poniżej 2.2% na ToxicChat, VGE PromptGuard v1g działa bez zmęczenia alertami.

| Metryka | VGE PromptGuard v1g | Protect AI v2 (bazowy) |

|---|---|---|

| F1 ogólne | 0.934 | 0.452 |

| F1 bezpośrednia iniekcja | 0.981 | — |

| INJ Recall (bezpośredni) | 96.7% | — |

| FPR (prompty bezpieczne) | 0.0% | 42.5% |

| Detekcja agentyczna | 97.5% | — |

| Parametry | 44M | 86M |

Obsługa języków i kodu

Podstawowe wsparcie językowe obejmuje angielski i polski, oba trenowane na natywnych korpusach, nie tłumaczeniach maszynowych. Polskie prompty biznesowe, scenariusze użycia narzędzi i wymiany konwersacyjne są klasyfikowane z niemal zerową nadmiarową obroną (2.5% FPR na polskim benchmarku).

Model radzi sobie również z klasyfikacją w kontekście kodu. Trenowany na kodzie źródłowym podczas fazy adaptacji domenowej MLM, wykrywa prompt injection ukryte w snippetach kodu, definicjach funkcji i komentarzach inline. Na benchmarku BIPIA code VGE PromptGuard v1g osiąga 100% recall (model bazowy uzyskuje 0%).

Rozszerzone wsparcie dla 5+ dodatkowych języków jest dostępne przez warstwę moderacji treści platformy VGE.

Jak go użyć

Model jest dostępny na huggingface.co/VigilGuard/vigil-llm-guard. Obsługuje inferencję PyTorch, ONNX Runtime do zoptymalizowanego wdrożenia na CPU oraz pełny pipeline preprocessingu do użytku produkcyjnego z długimi promptami i kontekstami agentycznymi.

W wdrożeniach produkcyjnych VGE PromptGuard v1g działa wewnątrz Vigil Guard Enterprise z automatycznym skalowaniem, integracją z SIEM i zarządzanym egzekwowaniem polityk. Zainstaluj VGE jedną komendą, a model zostanie wdrożony, skonfigurowany i monitorowany automatycznie.